Idee Come penseremo?

Intelligenza artificiale: quando i mezzi contano più dei fini

La tensione finalistica, una specie di riedizione del “sol dell’avvenir”, apre un tema rispetto a come gestire gli step di avanzamento e i risultati intermedi. Sopratutto se c'è di mezzo l'AI

Nell’era del purpose, dello scopo attribuito a finalità generali, i mezzi assumono una valenza sempre più strumentale. Sono, appunto, supporti che servono per raggiungere fini predeterminati e che sempre più stanno oltre la linea dell’orizzonte del “qui e ora”. Del resto è quasi inevitabile in una fase storica caratterizzata da transizioni di diversa natura e variamente intrecciate che dovrebbero approdare verso un agognato nuovo paradigma. Questa tensione finalistica, una specie di riedizione del “sol dell’avvenir”, apre un tema, forse sottovalutato, rispetto a come gestire gli step di avanzamento e i risultati intermedi. È questo il regno della managerialità che può essere variamente interpretata. Può risolversi in un approccio di tipo burocratico e procedurale (forse prevalente), oppure configurarsi attraverso un approccio di missione. Una modalità che prevede per i livelli tecnici ed esecutivi l’assegnazione di consegne in forma di linee guida che fanno riferimento alle finalità generali lasciando poi margini di libertà, autonomia, creatività su come raggiungerle. È una tecnica di derivazione militare trasferita “con un certo successo” anche nelle scuole di management evidenziando gli attributi di flessibilità e adattamento rispetto ad approcci più rigidi che soprattutto in contesti caratterizzati da elementi di incertezza come quelli attuali mostrano chiari limiti. D’altro canto sono stati anche evidenziati i limiti di un approccio che enfatizzando le finalità e lasciando libertà di azione può generare, come in effetti è successo, comportamenti quantomeno discutibili. Portando il modello alle estreme conseguenze si tratta della classica giustificazione addotta da vertici politici e militari che non si sentono responsabili di crimini di guerra perché i loro sottoposti avrebbero operato in autonomia sulla base di indicazioni generali.

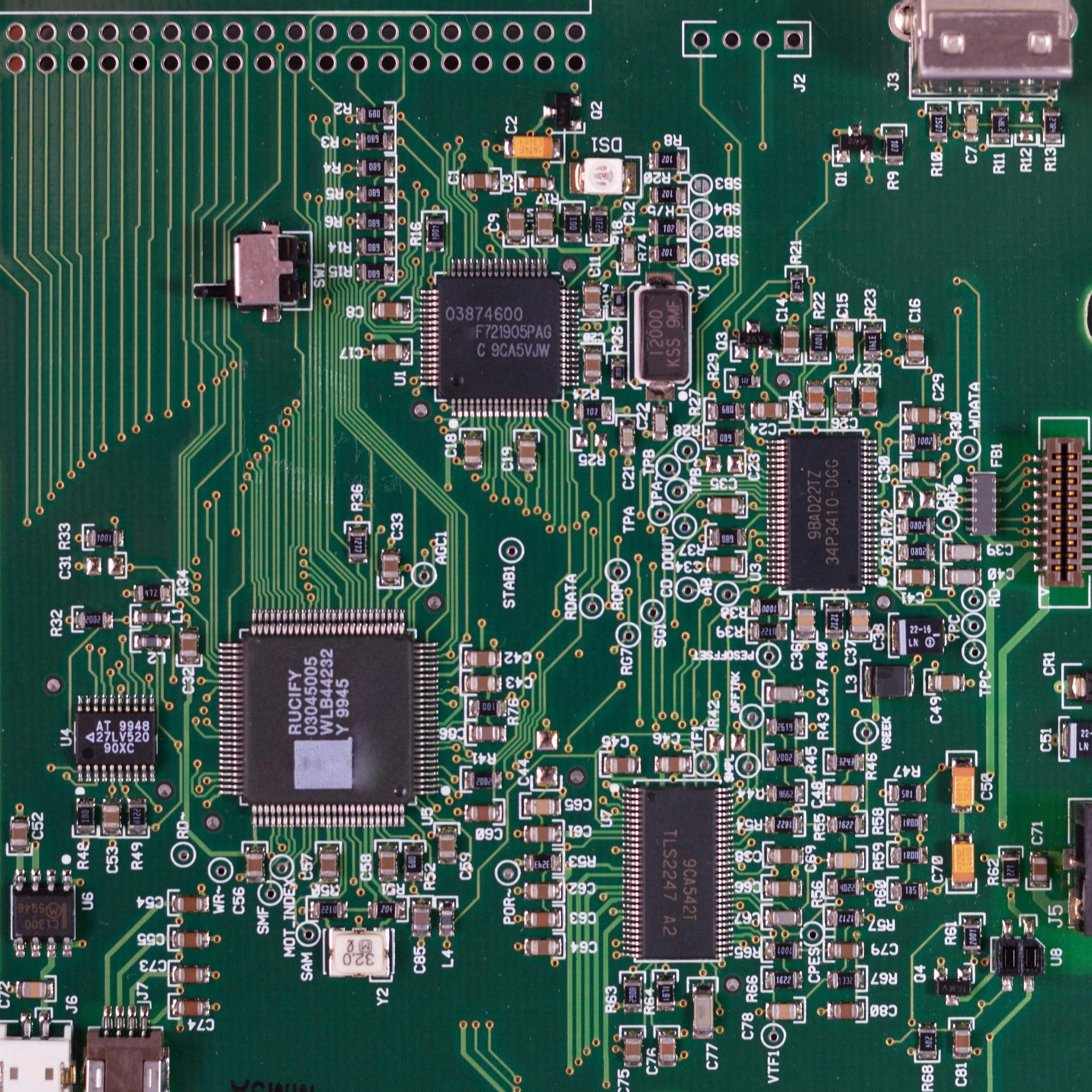

Fin qui la vicenda è tutta inscritta nella sfera dei comportamenti umani, ma con l’avvento dell’intelligenza artificiale generativa si assiste a un salto di scala. Nel libro “Machina Sapiens” di Nello Cristianini si legge infatti che il governo delle risorse di IA si gioca non solo a livello di presidio delle finalità prevedendo l’introduzione di “filtri etici” ma anche nel modo in cui chat Gpt e simili gestiscono i passaggi intermedi. Pare infatti che la tensione a raggiungere l’obiettivo – che ancora non si sa per quanto consiste in “imbeccate” umane – porti l’IA a utilizzare in modo diciamo “disinvolto” i suoi mezzi ovvero le fonti dati che vengono ricombinate per generare risposte. Da qui scaturirebbero le “confabulazioni” – leggi errori – più ricorrenti. Forse anche il linguaggio utilizzato, in particolare il suo tone of voice improntato al convincimento, potrebbe contribuire in tal senso. Dunque, come sostiene Cristianini «controllare l’allineamento non solo degli obiettivi ultimi, ma anche di quelli intermedi sarà un problema importante. E non sarà facile, dato che anche azioni perfettamente innocue, organizzate nel modo sbagliato, possono diventare nocive».

Nel mondo umano si è cercato di risolvere questo dilemma usando il bastone e la carota, dove il primo consiste in strumenti di micro regolazione come standard gestionali, codici comportamentali, decisioni condivise, ecc. e la seconda nel promuovere e gestire collettività intermedie – gruppi di lavoro, comunità di pratica, ecc. – che hanno assunto, o sono state messe in grado di esercitare, un certo autocontrollo tra pari. Ma con l’intelligenza aliena delle macchine, della quale peraltro ancora non conosciamo bene le modalità attraverso cui si alimenta ed evolve, servono altre soluzioni. Una potrebbe consistere nell’introdurre una maggiore pulizia del suo propellente, ovvero i dati. Lo sviluppo degli applicativi IA è stato infatti accelerato, probabilmente anche per finalità di business, grazie all’uso massiccio di “carburante sporco” rappresentato da dati grezzi che sono tali non solo perché mal collezionati e organizzati ma anche perché portano con sé distorsioni di ordine politico-culturale e ideologico. Dati quindi maschili, bianchi, performativi, ecc. Produrre quindi database “neutralizzati” in tal senso potrebbe permettere all’intelligenza artificiale di operare sugli step intermedi, dove peraltro eccelle rispetto a quella umana, senza fare troppi guai.

Foto di Miguel Á. Padriñán/Pexels

Si può usare la Carta docente per abbonarsi a VITA?

Certo che sì! Basta emettere un buono sulla piattaforma del ministero del valore dell’abbonamento che si intende acquistare (1 anno carta + digital a 80€ o 1 anno digital a 60€) e inviarci il codice del buono a abbonamenti@vita.it